Adore__

[Bayesian statistics] Maximum Likelihood Estimation 본문

[Bayesian statistics] Maximum Likelihood Estimation

3_GreenHeart 2023. 4. 22. 17:41Source

- StatQuest with Josh Starmer

- https://angeloyeo.github.io/2020/07/17/MLE.html

결합 확률밀도 함수란?

우선 결합확률이란 두 개의 사건이 동시에 일어날 확률을 의미한다.

서로 배반되는 두 사건 A, B가 있을 때, 두 사건이 동시에 일어나는 확률을 P(A∩B) 라고 하며

이 확률을 A, B의 결합확률이라고 정의한다.

▪️Likelihood Estimation

먼저 Likelihood와 probability를 비교해보자

확률 probability 이란, 고정된 한가지의 확률분포 안에서 내가 원하는 관측값(또는 관측 구간)이 갖는 확률을 말한다.

✔︎ Probability = P(관측값 | 확률분포)

반면 'likelihood'라는 것은, 고정된 사건데이터들이 해당 분포에서 나왔을 가능도를 말한다.

이때 분포의 개수는 여러개가 될 수 있다.

예를 들어 후보 분포 A,B,C가 있을 때, 분포 A의 가능도라는 것은 지금 얻은 데이터가 분포 A에서 일어났을 가능성을 수치로 나타낸 것이다.

✔︎ Likelihood = L(확률분포 | 관측값)

▪️Maximum Likelihood Estimation

이러한 가능도함수의 최대값을 찾는 것이 MLE이다.

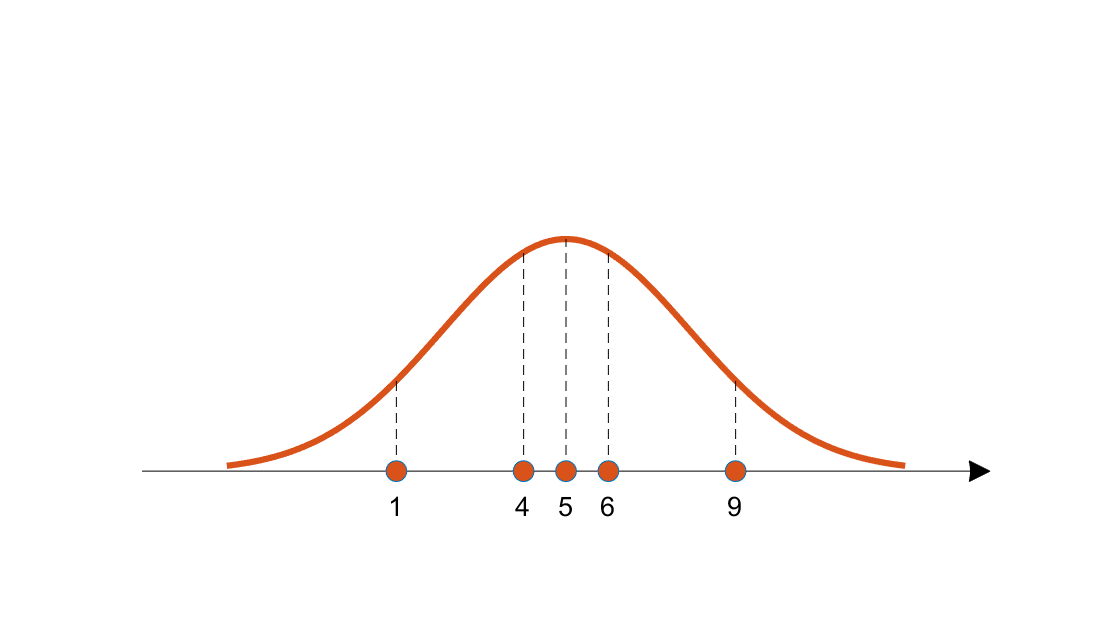

위 그림에서 다시 설명하자면, Likelihood는 고정된 데이터 (1,4,5,....9)가 현재 빨간색 분포에서 나왔을 가능도이다.

이를 수치적으로 구하기 위해서는 각 데이터 sample에서 자신이 나왔을 후보 분포에 대한 높이 (likelihood 기여도)를 계산해서

다 곱해준다.

왜 더하기가 아니라 곱하기일까? '독립성'을 생각해보자. 만약 두개의 사건이 서로 독립적으로 연달아 일어날 경우 우리는 그 확률을 곱해주기때문이다.

이 값들을 다 곱하면 결국 빨간색 분포에 대한 가능도가 나온다.

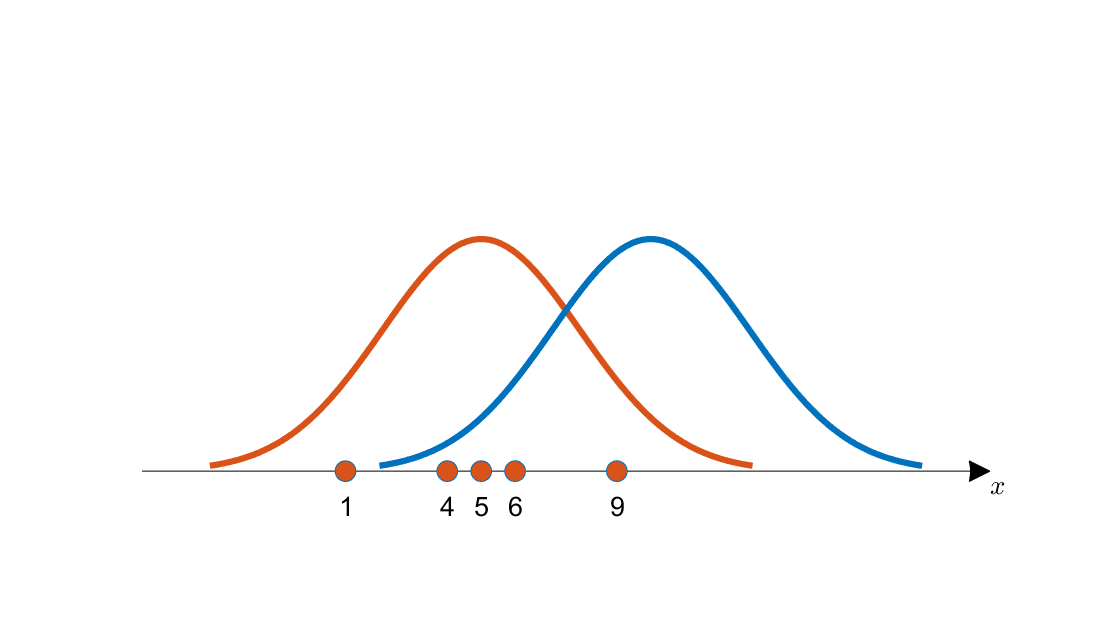

여러 후보 분포들 중, 이렇게 구한 값이 최대가 되도록 하는 분포를 찾는 것이 MLE이다.

왼쪽 그림에서는 파란색 분포의 가능도가 빨간색 분포의 가능도보다 낮을 것을 예상할 수 있다.

오른쪽 그림처럼 분포의 평균값을 오른쪽으로 이동하면, 각 분포에 대한 빨간점의 높이가 점점 높아지므로 가능도 또한 올라간다.

그러다 분포 곡선이 빨간점들의 영역을 벗어나게 되면 다시 감소한다.

'Basis > Statistics, Probability' 카테고리의 다른 글

| [Measure] Dice coefficient / Hausdorff (0) | 2023.06.13 |

|---|---|

| [Measure] Peak Signal-to-noise ratio, PSNR and SSIM (0) | 2023.06.13 |

| [Bayesian statistics] 베이즈 정리 (0) | 2023.04.22 |